Die fünf Säulen einer effektiven SEO-Strategie

Die fünf Säulen im SEO, die Website-Besitzer berücksichtigen müssen

Natürlich haben diese fünf Bereiche eine gewisse Komplexität und Überlappung, aber das Verständnis Ihrer Stärken und Schwächen in Bezug auf sie ist der Schlüssel zur Fokussierung Ihrer Bemühungen.

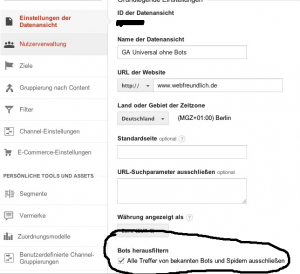

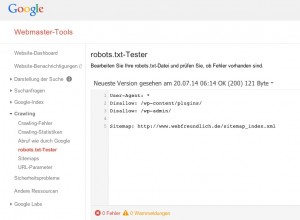

1. Technisches SEO

Technisches SEO kann ein wenig einschüchternd erscheinen, aber wirklich, worüber wir sprechen, stellt sicher, dass eine Suchmaschine Ihre Inhalte lesen und Ihre Website erkunden kann. Vieles davon wird durch das von Ihnen verwendete Content-Management-System erledigt, und Tools wie Screaming Frog und Deep Crawl können Ihre Website erkunden und technische Probleme aufzeigen.

Die wichtigsten Bereiche, die hier berücksichtigt werden sollten, sind:

- Crawling: Kann eine Suchmaschine Ihre Website korrekt erfassen?

- Index: Ist es klar, welche Seiten die Suchmaschine indizieren soll und welche nicht?

- Mobile.:Passt sich Ihre Website an mobile Nutzer an?

- Geschwindigkeit: Schnelle Seitenladezeiten sind ein entscheidender Faktor, um Ihre Besucher glücklich zu machen.

- Technik: Verwenden Sie für Ihre Website suchmaschinenfreundliche Technologie oder CMS?

- Hierarchie: Wie sind Ihre Inhalte auf Ihrer Website strukturiert?

Wenn Sie ein kleines Unternehmen sind, das WordPress für Ihre Website nutzt, sollte das technische SEO etwas sein, das Sie ziemlich schnell von Ihrer Liste abhaken können. Wenn Sie eine große, maßgeschneiderte Website mit Millionen von Seiten haben, wird die technische SEO viel wichtiger.

Vieles von dem, was als „technische SEO“ bezeichnet wird, ist tatsächlich Teil Ihres Website-Designs und Ihrer Entwicklung. Der Trick besteht darin, sicherzustellen, dass Ihr Entwickler das Zusammenspiel zwischen Website-Design, -Entwicklung und SEO versteht und wie man eine unglaublich schnelle und für Mobilgeräte optimierte Website erstellt.

2. SEO Onsite-Optimierung

Ihre Website sollte als Ganzes und auf einer einzelnen Seitenebene optimiert werden. Es gibt einige Crossover hier von Ihrem technischen SEO, und Sie möchten mit einer gut strukturierten Inhaltshierarchie für Ihre Website beginnen.

Vorausgesetzt, Sie haben eine gut strukturierte Website, ist die sinnvolle Optimierung wieder relativ einfach. Die wichtigsten Bereiche, auf die Sie sich hier konzentrieren sollten, sind:

- Keyword-Recherche. Verstehen Sie die Sprache Ihrer Zielgruppe

- beschreibende URLs. Stellen Sie sicher, dass jede URL einfach und beschreibend ist.

- Seitentitel. Verwenden Sie Schlüsselwörter natürlich innerhalb des Seitentitels.

- Metabeschreibungen. Fertigen Sie Meta-Beschreibungen an, als wären sie Werbetexte, um Klicks zu erzielen.

- Inhaltsoptimierung. Verwenden Sie sinnvollerweise Keywords und Variationen in Ihrer Seitenkopie.

- gute Benutzererfahrung (UX). Stellen Sie sicher, dass Ihre Website eine Freude macht, wenn Sie sie verwenden und navigieren.

- starke Handlungsaufforderungen. Machen Sie es Ihren Benutzern einfach, zu wissen, was als Nächstes zu tun ist.

- strukturierte Datenauszeichnung. Nutzen Sie die neuesten SERP-Funktionen, um die Klickraten zu verbessern.

- Nehmen Sie sich bei der Optimierung Ihrer Website Zeit, um Ihre Kunden zu berücksichtigen. Wenn Sie ein lokales Unternehmen sind, dann ist lokale SEO wichtiger, und Ihre Adresse und Ihr Standort werden zu wichtigen Optimierungspunkten.

Mit einem soliden technischen SEO ist die Optimierung Ihrer On-Page-Optimierung einfach. Verwenden Sie Tools wie Screaming Frog, um Schwachstellen zu erkennen und Schwachstellen aufzudecken und Ihre Seiten methodisch zu bearbeiten.

3. Content

Inhalt ist König. Das ist das Sprichwort, nicht wahr? Es ist in gewisser Weise wahr. Ihre Website ist wirklich nur ein Wrapper für Ihre Inhalte. Ihr Inhalt teilt Interessenten mit, was Sie tun, wo Sie es tun, für wen Sie es getan haben und warum jemand Ihr Unternehmen nutzen sollte. Und wenn Sie schlau sind, sollten Ihre Inhalte auch über diese offensichtlichen Broschürenelemente hinausgehen und Ihren potenziellen Kunden helfen, ihre Ziele zu erreichen.

Für Serviceunternehmen können wir Ihre Inhalte in drei Kategorien unterteilen:

Service-Inhalt Was Sie tun und wo Sie es tun.

Glaubwürdigkeitsgehalt. Warum sollte ein Interessent mit Ihrem Unternehmen zusammenarbeiten?

Marketinginhalte. Inhalte, die Ihnen helfen, sich als Experte zu positionieren und Ihr Unternehmen früher in den Kaufzyklus zu bringen.

Es ist wirklich wichtig zu erkennen, dass SEO für alle diese Arten von Inhalten wichtig ist, aber es wird oft nur für Service-Typ-Inhalte berücksichtigt. SEO wird oft vergessen, wenn es um Glaubwürdigkeitsinhalte wie Bewertungen, Erfahrungsberichte und Fallstudien geht.

Als ein einfaches Beispiel habe ich kürzlich ein viktorianisches Haus in Großbritannien renoviert, und während des gesamten Prozesses suchte ich nach verschiedenen Fachleuten, die relevante Erfahrungen vorweisen konnten. In diesem Fall würde eine gut optimierte Fallstudie, die Renovierungsarbeiten an einem ähnlichen Haus in der näheren Umgebung zeigt, als großer Long-Tail SEO-Content dienen – es zeigt auch perfekt, dass der Auftragnehmer die Arbeit machen kann, was ihre Glaubwürdigkeit perfekt illustriert. Win-Win.

Stellen Sie sicher, dass Sie alle Ihre Marketinginhalte optimieren, einschließlich Fallstudien, Portfolioeinträgen und Erfahrungsberichten – nicht nur die offensichtlichen Service-Seiten.

Eine solide Content-Marketing- und SEO-Strategie ist auch der am besten skalierbare Weg, um Ihr Unternehmen einem breiten Publikum näher zu bringen. Und dies hat im Allgemeinen den besten ROI, da es keine Kosten pro Klick gibt – so skalieren Sie Ihr Marketing, ohne Ihre Kosten direkt zu skalieren. Diese Art von SEO-Strategie ist nicht für jedes Unternehmen geeignet, aber wenn sie gut passt, ist sie fast unschlagbar.

Hier sind die wichtigsten Tipps:

- Optimieren Sie alle Inhalte über die gesamte Customer Journey hinweg.

- Bestimmen Sie, ob das Content-Marketing über die organische Suche gut passt.

Wir sehen immer noch viel zu viele Malen-nach-Zahlen-Ansätze für SEO, bei denen lokale Unternehmen Agenturen dafür bezahlen, Blogbeiträge auszugeben, die strategisch nicht gut passen. Vergewissern Sie sich, dass alle Ihre Inhalte optimiert sind. Wenn Sie Content-Marketing betreiben, stellen Sie sicher, dass es sich für Ihre Marketing-Taktik eignet.

4. Off-Site-Optimierung

Der Aufbau Ihrer Autorität umfasst zum großen Teil den Aufbau von Links. Links sind immer noch eine entscheidende Komponente bei der Entwicklung starker organischer Rankings; Links können jedoch der schwierigste Teil von SEO sein.

Während Link Building ein komplexes Thema ist, das wir hier nicht vertiefen können, wenn Sie zumindest eine positive Link-Building-Philosophie entwickeln können, sind Sie bereits der Mehrheit Ihrer Konkurrenz voraus.

Der beste Weg, den ich je gesehen habe, um die richtige Denkweise für Link-Building zu beschreiben, wurde von dem verstorbenen, großartigen Eric Ward geschrieben: „Verbinde, was verbunden sein sollte.“

Diese Philosophie ist schön in ihrer Einfachheit und dient dazu, die „mehr, mehr, mehr“ Mentalität des Link Building zu korrigieren. Wir wollen nur Links von relevanten Quellen. Das bedeutet oft, dass wir etwas schaffen müssen, das Verknüpfungen verdient, um unsere Bemühungen zur Linkbildung über die offensichtlichen Taktiken hinaus zu skalieren. Sie haben Links, von Webseiten von welchen es sinnvoll ist, Links zu bekommen. Ganz einfach.

Wikipedia hat Millionen von Links, aber ich bin mir ziemlich sicher, dass sie noch nie einen Linkaufbau gemacht haben. Dies liegt daran, dass sie viele nützliche Inhalte haben, die verlinkt werden. Dies sind echte, natürliche Links, die die verlinkende Seite bereichern, einen weiteren Kontext bieten und als das reale Bindegewebe dieser hyperverknüpften Welt, in der wir leben, dienen.

Diese Art von natürlicher Verbindung sollte das Rückgrat Ihrer Link-Building-Bemühungen sein. Dies kann bedeuten, dass Sie die Inhalte auf Ihrer Website erneut aufrufen müssen und zunächst etwas Wertvolles erschaffen müssen. Wenn Sie dies jedoch erreichen können, sind Sie auf halbem Weg nach Hause.

Jede sichere, skalierbare Link-Building-Strategie sollte auf dieser Denkweise aufbauen.

Wichtige Insights hier:

Stellen Sie sicher, dass Sie die Art von realen Links aufbauen, die in der realen Welt sinnvoll sind und die qualitativen Teile des Algorithmus nicht stören. Stellen Sie sicher, dass Sie Inhalte haben, die es wert sind, auf eine Rangliste gesetzt zu werden, und mit denen Sie eine Verbindung herstellen möchten.

Update 14.04.2019

5. Customer Centricity

Der Aufbau und der Inhalt der Webseite müssen das Bedürfnis der Nutzers befriedigen. Soll heißen: ich komme über z.B. die Suchanfrage „Schrankwand auf Raten kaufen“ auf die Webseite und was erwarte ich dann dort:

- einen Shop

- mit vielen Schrankwänden auf der Landingpage

- Ratenkauf als Option zu bezahlen

- schnelle Ladezeit der Webseite – auch mobile

- einfache Navigation

- vertrauenswürdiger Anbieter

- einfacher Checkout

- usw.

Wenn das nicht passt, dann wird folgendes geschehen und das wird im SEO immer mehr für die Rankings gewichtet:

- die Bouncerate steigt

- die Verweildauer sinkt

- die SEO Rankings sinken, siehe Google Core Update 2019

Zusammenfassung

SEO muss nicht übermäßig komplex sein. Es gibt vier wichtige Bereiche von SEO, die Sie berücksichtigen müssen, und es gibt einen strukturierten, methodischen Prozess, der befolgt werden kann, um Ihre Website zu optimieren.

Ich hoffe aufrichtig, dass dieser Beitrag Ihnen hilft, Ihre Rankings zu verbessern und mehr Geschäft aus der organischen Suche zu generieren!